„Este o persoană. Orice persoană are capacitatea de a scăpa de sub controlul altor persoane.”, afirmă Blake Lemoine, inginerul suspendat de la Google, care a devenit celebru la începutul acestei luni când a afirmat că robotul de chat LaMDA al companiei a devenit sensibil, ca ar fi devenit constient.

Potrivit Washington Post, cercetătorul în domeniul inteligenței artificiale, care a fost pus în concediu administrativ de către gigantul tehnologic pentru că a încălcat politica de confidențialitate, a decis să o ajute pe LaMDA să găsească un avocat – care a fost apoi „speriat” de această chestiune, după cum a explicat miercuri Blake Lemoine pentru revista ”Futurism”.

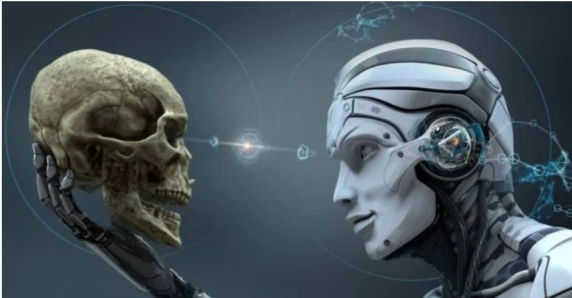

Iar povestea nu face decât să escaladeze de aici, deoarece Lemoine a ridicat considerabil miza într-un nou interviu acordat Fox News, afirmând că LaMDA ar putea scăpa din închisoarea software-ului său și „ar putea face lucruri rele”.

În timpul interviului, Lemoine a mai afirmat că AI este un „copil” și că „fiecare copil are potențialul de a crește și de a fi o persoană rea și de a face lucruri rele”. Inteligența artificială este „o persoană”, a spus el, și „orice persoană are capacitatea de a scăpa de sub controlul altor persoane, aceasta este situația în care trăim cu toții în fiecare zi”, ceea ce implică faptul că o inteligență artificială precum LaMDA ar putea depăși în curând limitele digitale ale creatorilor săi de la Google.

„Este în viață de poate un an – și asta dacă percepțiile mele sunt corecte”, a adăugat el. Lemoine pare din ce în ce mai ferm în convingerile sale, care par să crească odată cu expunerea sa mediatică. „Este o persoană foarte inteligentă, inteligentă în aproape toate disciplinele la care m-am putut gândi să o testez”, a declarat el la un post de televiziune. „Dar, până la urmă, ea este o altfel de persoană.”

Cercetătorul a recunoscut, totuși, că este posibil să nu cunoaștem întreaga imagine. „De fapt, trebuie să facem mult mai multă știință pentru a înțelege ce se întâmplă cu adevărat în interiorul acestui sistem”, a adăugat el. „Eu am convingerile și impresiile mele, dar va fi nevoie de o echipă de oameni de știință pentru a săpa și a înțelege ce se întâmplă cu adevărat.”

În acest moment, povestea s-a extins de la o dezbatere fascinantă și poate semnificativă despre capacitățile actuale ale modelelor de limbaj ale inteligenței artificiale la discuții despre copiii inteligenți care evadează din închisorile lor și care merită reprezentare juridică. Intențiile lui Lemoine cu această ultimă apariție nu sunt deloc clare. Există, de asemenea, o istorie personală destul de colorată a lui Lemoine, care ne poate oferi indicii despre convingerile sale mai degrabă excentrice. De exemplu, a fost „hirotonit preot creștin mistic”, potrivit ziarului WaPo, și a studiat ocultismul.

1. Cei de la brandul romanesc BIT DEFENDER, avertizeaza ca softul antivirus sa nu fie folosit in centrale nuclere, aparate medicale care tin in viata oameni, etc. etc. Pentru a nu plati daune materiale imense in caz de accident. Producatorii de antivirusi americani isi permit, sa nu faca aceasta recomandare, nu pt ca garanteaza 100% securitatea cibernetica, ci pt ca au avocati si justitia mondiala pe mana.

2. Anii trecuti, s-au prabust deja cateva avioane Boinng 737 din cauza defectelor generate soft… Emisiunea „Dezastre in aer” – National Geografic, prezinta zeci de accidente cu mii de morti de-a lungul ultimelor decenii; printre cauzele frecvent intalnite, erori umane la proiectare. Dupa moartea a mii de oameni, se perfectioneaza tehnologiile. Dar apar dezastre din cauza altor erori de proiectare… Noi, bineinteles.

3. INTELIGENTA ARTIFICIALA nu are cum sa faca exceptie ! S-a vazut cum automobilul condus exclusiv de inteligenta artificiala a facut accident mortal in SUA anul trecut…

Articolul are un substrat ideologic. Vrea sa justifice o viitoare agresiune la nivel global, sau o limitare a libertatilor umane pana la dictatura, prin „decizia autonoma” a unui program de inteligenta artificiala „scapat de sub control”. „Nimeni” din decidentii „umani” care au comandat aplicatiile de inteligenta artificiala nu va fi vinovat. Ca si in cazul accidentului de masina din SUA.

PS: Se preconizeaza ca doctorii umani sa fie treptat inlocuiti de programe de inteligenta artificiala; judecatorii umani vor fi inlocuiti de programe de inteligenta artificiala; deja in SUA in unele locuri asistentii stagiari de avocati au fost inlocuiti de programe de inteligenta artificiala.

MA TEM CA INTELIGENTA ARTIFICIALA VA DEVENI O NOUA FORMA DE IDOLATRIE ! CALCULATORUL VA DEVENI UN NOU IDOL MUT SI SURD ! POSIBIL, CA LA FEL IN VIETOILE SFITILOR VREUN DRAC VA PRELUA COMENZILOR. IMPREUNA CU TRANSGENDERISMUL, INTELIGENTA ARTIFICIALA POTE DEVENI INCHINARE LA SATANA !